Единая система хранения данных. Системы хранения данных компании Intel

Читайте также

С повседневным усложнением сетевых компьютерных систем и глобальных корпоративных решений мир начал требовать технологий, которые бы дали толчок к возрождению корпоративных систем хранения информации (сторедж-систем). И вот, одна единая технология приносит в мировую сокровищницу достижений в области сторедж невиданное ранее быстродействие, колоссальные возможности масштабирования и исключительные преимущества общей стоимости владения. Обстоятельства, которые сформировались с появлением стандарта FC-AL (Fibre Channel - Arbitrated Loop) и SAN (Storage Area Network), которая развивается на его основе, обещают революцию в дата-ориентированных технологиях компьютинга.

«The most significant development in storage we"ve seen in 15 years»

Data Communications International, March 21, 1998

Формальное определение SAN в трактовке Storage Network Industry Association (SNIA):

«Сеть, главной задачей которой является передача данных между компьютерными системами и устройствами хранения данных, а также между самими сторедж-системами. SAN состоит из коммуникационной инфраструктуры, которая обеспечивает физическую связь, а также отвечает за уровень управления (management layer), который объединяет связи, сторедж и компьютерные системы, осуществляя передачу данных безопасно и надежно».

SNIA Technical Dictionary, copyright Storage Network Industry Association, 2000

Варианты организации доступа к сторедж-системам

Различают три основных варианта организации доступа к системам хранения:

- SAS (Server Attached Storage), сторедж, присоединенный к серверу;

- NAS (Network Attached Storage), сторедж, подсоединенный к сети;

- SAN (Storage Area Network), сеть хранения данных.

Рассмотрим топологии соответствующих сторедж-систем и их особенности.

SAS

Сторедж-система, присоединенная к серверу. Знакомый всем, традиционный способ подключения системы хранения данных к высокоскоростному интерфейсу в сервере, как правило, к параллельному SCSI интерфейсу.

Рисунок 1. Server Attached Storage

Использование отдельного корпуса для сторедж-системы в рамках топологии SAS не является обязательным.

Основное преимущество сторедж, подсоединенного к серверу, в сравнении с другими вариантами - низкая цена и высокое быстродействие из расчета один сторедж для одного сервера. Такая топология является самой оптимальной в случае использования одного сервера, через который организуется доступ к массиву данных. Но у нее остается ряд проблем, которые побудили проектировщиков искать другие варианты организации доступа к системам хранения данных.

К особенностям SAS можно отнести:

- Доступ к данных зависит от ОС и файловой системы (в общем случае);

- Сложность организации систем с высокой готовностью;

- Низкая стоимость;

- Высокое быстродействие в рамках одной ноды;

- Уменьшение скорости отклика при загрузке сервера, который обслуживает сторедж.

NAS

Сторедж-система, подсоединенная к сети. Этот вариант организации доступа появился сравнительно недавно. Основным его преимуществом является удобство интеграции дополнительной системы хранения данных в существующие сети, но сам по себе он не привносит сколь-нибудь радикальных улучшений в архитектуру сторедж. Фактически NAS есть чистый файл-сервер, и сегодня можно встретить немало новых реализаций сторедж типа NAS на основе технологии тонкого сервера (Thin Server).

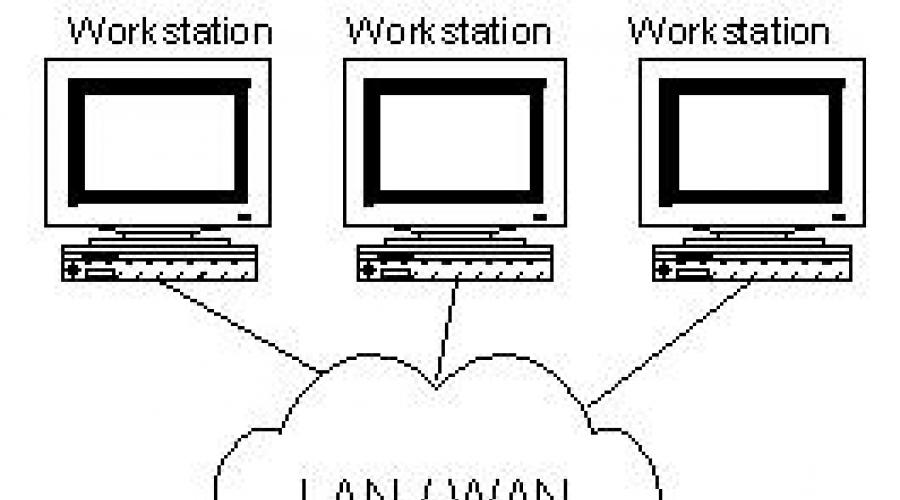

Рисунок 2. Network Attached Storage.

Особенности NAS:

- Выделенный файл-сервер;

- Доступ к данным не зависит от ОС и платформы;

- Удобство администрирования;

- Максимальная простота установки;

- Низкая масштабируемость;

- Конфликт с трафиком LAN/WAN.

Сторедж, построенный по технологии NAS, является идеальным вариантом для дешевых серверов с минимальным набором функций.

SAN

Сети хранения данных начали интенсивно развиваться и внедряться лишь с 1999 года. Основой SAN является отдельная от LAN/WAN сеть, которая служит для организации доступа к данным серверов и рабочих станций, занимающихся их прямой обработкой. Такая сеть создается на основе стандарта Fibre Channel, что дает сторедж-системам преимущества технологий LAN/WAN и возможности по организации стандартных платформ для систем с высокой готовностью и высокой интенсивностью запросов. Почти единственным недостатком SAN на сегодня остается относительно высокая цена компонент, но при этом общая стоимость владения для корпоративных систем, построенных с использованием технологии сетей хранения данных, является довольно низкой.

Рисунок 3. Storage Area Network.

К основным преимуществам SAN можно отнести практически все ее особенности:

- Независимость топологии SAN от сторедж-систем и серверов;

- Удобное централизованное управление;

- Отсутствие конфликта с трафиком LAN/WAN;

- Удобное резервирование данных без загрузки локальной сети и серверов;

- Высокое быстродействие;

- Высокая масштабируемость;

- Высокая гибкость;

- Высокая готовность и отказоустойчивость.

Следует также заметить, что технология эта еще довольно молодая и в ближайшее время она должна пережить немало усовершенствований в области стандартизации управления и способов взаимодействия SAN подсетей. Но можно надеяться, что это угрожает пионерам лишь дополнительными перспективами первенства.

FC как основа построения SAN

Подобно LAN, SAN может создаваться с использованием различных топологий и носителей. При построении SAN может использоваться как параллельный SCSI интерфейс, так и Fibre Channel или, скажем, SCI (Scalable Coherent Interface), но своей все возрастающей популярностью SAN обязана именно Fibre Channel. В проектировании этого интерфейса принимали участие специалисты со значительным опытом в разработке как канальных, так и сетевых интерфейсов, и им удалось объединить все важные положительные черты обеих технологий для того, чтобы получить что-то в самом деле революционно новое. Что именно?

Основные ключевые особенности канальных:

- Низкие задержки

- Высокие скорости

- Высокая надежность

- Топология точка-точка

- Небольшие расстояния между нодами

- Зависимость от платформы

- Многоточечные топологии

- Большие расстояния

- Высокая масштабируемость

- Низкие скорости

- Большие задержки

- Высокие скорости

- Независимость от протокола (0-3 уровни)

- Большие расстояния

- Низкие задержки

- Высокая надежность

- Высокая масштабируемость

- Многоточечные топологии

Традиционно сторедж интерфейсы (то, что находится между хостом и устройствами хранения информации) были преградой на пути к росту быстродействия и увеличению объема систем хранения данных. В то же время прикладные задачи требуют значительного прироста аппаратных мощностей, которые, в свою очередь, тянут за собой потребность в увеличении пропускной способности интерфейсов для связи со сторедж-системами. Именно проблемы построения гибкого высокоскоростного доступа к данным помогает решить Fibre Channel.

Стандарт Fibre Channel был окончательно определен за последние несколько лет (с 1997-го по 1999-й), на протяжении которых была проведена колоссальная работа по согласованию взаимодействия производителей различных компонент, и было сделано все необходимое, чтобы Fibre Channel превратился из чисто концептуальной технологии в реальную, которая получила поддержку в виде инсталляций в лабораториях и вычислительных центрах. В году 1997 были спроектированы первые коммерческие образцы краеугольных компонент для построения SAN на базе FC, таких как адаптеры, хабы, свичи и мосты. Таким образом, уже начиная с 1998-го года FC используется в коммерческих целях в деловой сфере, на производстве и в масштабных проектах реализации систем, критичных к отказам.

Fibre Channel - это открытый промышленный стандарт высокоскоростного последовательного интерфейса. Он обеспечивает подключение серверов и сторедж-систем на расстоянии до 10 км (при использовании стандартного оснащения) на скорости 100 MB/s (на выставке Cebit"2000 были представлены образцы продукции, которые используют новый стандарт Fibre Channel со скоростями 200 MB/s на одно кольцо, а в лабораторных условиях уже эксплуатируются реализации нового стандарта со скоростями 400 MB/s, что составляет 800 MB/s при использовании двойного кольца). (На момент публикации статьи ряд производителей уже начал отгружать сетевые карточки и свичи на FC 200 MB/s.) Fibre Channel одновременно поддерживает целый ряд стандартных протоколов (среди которых TCP/IP и SCSI-3) при использовании одного физического носителя, который потенциально упрощает построение сетевой инфраструктуры, к тому же это предоставляет возможности для уменьшения стоимости монтажа и обслуживания. Тем не менее использование отдельных подсетей для LAN/WAN и SAN имеет ряд преимуществ и является рекомендованным по умолчанию.

Одним из важнейших преимуществ Fibre Channel наряду со скоростными параметрами (которые, кстати, не всегда являются главными для пользователей SAN и могут быть реализованы с помощью других технологий) является возможность работы на больших расстояниях и гибкость топологии, которая пришла в новый стандарт из сетевых технологий. Таким образом, концепция построения топологии сети хранения данных базируется на тех же принципах, что и традиционные сети, как правило, на основе концентраторов и коммутаторов, которые помогают предотвратить падение скорости при возрастании количества нод и создают возможности удобной организации систем без единой точки отказов.

Для лучшего понимания преимуществ и особенностей этого интерфейса приведем сравнительную характеристику FC и Parallel SCSI в виде таблицы.

Таблица 1. Сравнение технологий Fibre Channel и параллельного SCSI

В стандарте Fibre Channel предполагается использование разнообразных топологий, таких как точка-точка (Point-to-Point), кольцо или FC-AL концентратор (Loop или Hub FC-AL), магистральный коммутатор (Fabric/Switch).

Топология point-to-point используется для подсоединения одиночной сторедж-системы к серверу.

Loop или Hub FC-AL - для подсоединения множественных сторедж устройств к нескольким хостам. При организации двойного кольца увеличивается быстродействие и отказоустойчивость системы.

Коммутаторы используются для обеспечения максимального быстродействия и отказоустойчивости для сложных, больших и разветвленных систем.

Благодаря сетевой гибкости в SAN заложена чрезвычайно важная особенность - удобная возможность построения отказоустойчивых систем.

Предлагая альтернативные решения для систем хранения данных и возможности по объединению нескольких сторедж для резервирования аппаратных средств, SAN помогает обеспечивать защиту аппаратно-программных комплексов от аппаратных сбоев. Для демонстрации приведем пример создания двухнодовой системы без точек отказов.

Рисунок 4. No Single Point of Failure.

Построение трех- и более нодовых систем осуществляется простым добавлением в FC сеть дополнительных серверов и подключением их к обоим концентраторам/ коммутаторам).

При использовании FC построение устойчивых к сбоям (disaster tolerant) систем становится прозрачным. Сетевые каналы и для сторедж, и для локальной сети можно проложить на основе оптоволокна (до 10 км и больше с использованием усилителей сигнала) как физического носителя для FC, при этом используется стандартная аппаратура, которая дает возможность значительно уменьшить стоимость подобных систем.

Благодаря возможности доступа ко всем компонентам SAN из любой ее точки мы получаем чрезвычайно гибко управляемую сеть данных. При этом следует заметить, что в SAN обеспечивается прозрачность (возможность видеть) всех компонентов вплоть до дисков в сторедж-системах. Эта особенность подтолкнула производителей компонентов к использованию своего значительного опыта в построении систем управления для LAN/WAN с тем, чтобы заложить широкие возможности по мониторингу и управлению во все компоненты SAN. Эти возможности включают в себя мониторинг и управление отдельных нод, сторедж компонентов, корпусов, сетевых устройств и сетевых подструктур.

В системе управления и мониторинга SAN используются такие открытые стандарты, как:

- SCSI command set

- SCSI Enclosure Services (SES)

- SCSI Self Monitoring Analysis and Reporting Technology (S.M.A.R.T.)

- SAF-TE (SCSI Accessed Fault-Tolerant Enclosures)

- Simple Network Management Protocol (SNMP)

- Web-Based Enterprise Management (WBEM)

Системы, построенные с использованием технологий SAN, не только обеспечивают администратору возможность следить за развитием и состоянием сторедж ресурсов, но и открывают возможности по мониторингу и контролю трафика. Благодаря таким ресурсам программные средства управления SAN реализуют наиболее эффективные схемы планирования объема сторедж и балансирование нагрузки на компоненты системы.

Сети хранения данных прекрасно интегрируются в существующие информационные инфраструктуры. Их внедрение не требует каких-либо изменений в уже существующих сетях LAN и WAN, а лишь расширяет возможности существующих систем, избавляя их от задач, ориентированных на передачу больших объемов данных. Причем при интеграции и администрировании SAN очень важным является то, что ключевые элементы сети поддерживают горячую замену и установку, с возможностями динамического конфигурирования. Так что добавить тот или другой компонент или осуществить его замену администратор может, не выключая систему. И весь этот процесс интеграции может быть визуально отображен в графической системе управления SAN.

Рассмотрев вышеперечисленные преимущества, можно выделить ряд ключевых моментов, которые непосредственно влияют на одно из основных преимуществ Storage Area Network - общую стоимость владения (Total Cost Ownership).

Невероятные возможности масштабирования позволяют предприятию, которое использует SAN, вкладывать деньги в серверы и сторедж по мере необходимости. А также сохранить свои вложения в уже инсталлированную технику при смене технологических поколений. Каждый новый сервер будет иметь возможность высокоскоростного доступа к сторедж и каждый дополнительный гигабайт сторедж будет доступен всем серверам подсети по команде администратора.

Прекрасные возможности по построению отказоустойчивых систем могут приносить прямую коммерческую выгоду от минимизации простоев и спасать систему в случае возникновения стихийного бедствия или каких-нибудь других катаклизмов.

Управляемость компонентов и прозрачность системы предоставляют возможность осуществлять централизованное администрирование всех сторедж ресурсов, а это, в свою очередь, значительно уменьшает затраты на их поддержку, стоимость которой, как правило, составляет более 50% от стоимости оснащения.

Влияние SAN на прикладные задачи

Для того чтобы нашим читателям стало понятней, насколько практически полезны технологии, которые рассматриваются в этой статье, приведем несколько примеров прикладных задач, которые без использования сетей хранения данных решались бы неэффективно, требовали бы колоссальных финансовых вложений или же вообще не решались бы стандартными методами.

Резервирование и восстановление данных (Data Backup and Recovery)

Используя традиционный SCSI интерфейс, пользователь при построении систем резервирования и восстановления данных сталкивается с рядом сложных проблем, которые можно очень просто решить, используя технологии SAN и FC.

Таким образом, использование сетей хранения данных выводит решение задачи резервирования и восстановления на новый уровень и предоставляет возможность осуществлять бэкап в несколько раз быстрее, чем раньше, без загрузки локальной сети и серверов работой по резервированию данных.

Кластеризация серверов (Server Clustering)

Одной из типичных задач, для которых эффективно используется SAN, является кластеризация серверов. Поскольку один из ключевых моментов в организации высокоскоростных кластерных систем, которые работают с данными - это доступ к сторедж, то с появлением SAN построение многонодовых кластеров на аппаратном уровне решается простым добавлением сервера с подключением к SAN (это можно сделать, даже не выключая системы, поскольку свичи FC поддерживают hot-plug). При использовании параллельного SCSI интерфейса, возможности по подсоединению и масштабируемость которого значительно хуже, чем у FC, кластеры, ориентированные на обработку данных, было бы тяжело сделать с количеством нод больше двух. Коммутаторы параллельного SCSI - весьма сложные и дорогие устройства, а для FC это стандартный компонент. Для создания кластера, который не будет иметь ни единой точки отказов, достаточно интегрировать в систему зеркальную SAN (технология DUAL Path).

В рамках кластеризации одна из технологий RAIS (Redundant Array of Inexpensive Servers) кажется особенно привлекательной для построения мощных масштабируемых систем интернет-коммерции и других видов задач с повышенными требованиями к мощности. По словам Alistair A. Croll, сооснователя Networkshop Inc, использование RAIS оказывается достаточно эффективным:«Например, за $12000-15000 вы можете купить около шести недорогих одно-двухпроцессорных (Pentium III) Linux/Apache серверов. Мощность, масштабируемость и отказоустойчивость такой системы будет значительно выше, чем, например, у одного четырехпроцессорного сервера на базе процессоров Xeon, а стоимость одинаковая».

Одновременный доступ к видео и распределение данных (Concurrent video streaming, data sharing)

Вообразите себе задачу, когда вам нужно на нескольких (скажем, >5) станциях редактировать видео или просто работать над данными огромного объема. Передача файла размером 100GB по локальной сети займет у вас несколько минут, а общая работа над ним будет очень сложной задачей. При использовании SAN каждая рабочая станция и сервер сети получают доступ к файлу на скорости, эквивалентной локальному высокоскоростному диску. Если вам нужны еще одна станция/сервер для обработки данных, вы сможете ее прибавить к SAN, не выключая сети, простым подсоединением станции к SAN коммутатору и предоставлением ей прав доступа к сторедж. Если же вас перестанет удовлетворять быстродействие подсистемы данных, вы сможете просто прибавить еще один сторедж и с использованием технологии распределения данных (например, RAID 0) получить вдвое большее быстродействие.

Основные компоненты SAN

Среда

Для соединения компонентов в рамках стандарта Fibre Channel используют медные и оптические кабели. Оба типа кабелей могут использоваться одновременно при построении SAN. Конверсия интерфейсов осуществляется с помощью GBIC (Gigabit Interface Converter) и MIA (Media Interface Adapter). Оба типа кабеля сегодня обеспечивают одинаковую скорость передачи данных. Медный кабель используется для коротких расстояний (до 30 метров), оптический - как для коротких, так и для расстояний до 10 км и больше. Используют многомодовый и одномодовый оптические кабели. Многомодовый (Multimode) кабель используется для коротких расстояний (до 2 км). Внутренний диаметр оптоволокна мультимодового кабеля составляет 62,5 или 50 микрон. Для обеспечения скорости передачи 100 МБ/с (200 МБ/с в дуплексе) при использовании многомодового оптоволокна длина кабеля не должна превышать 200 метров. Одномодовый кабель используется для больших расстояний. Длина такого кабеля ограничена мощностью лазера, который используется в передатчике сигнала. Внутренний диаметр оптоволокна одномодового кабеля составляет 7 или 9 микрон, он обеспечивает прохождение одиночного луча.

Коннекторы, адаптеры

Для подсоединения медных кабелей используются коннекторы типа DB-9 или HSSD. HSSD считается более надежным, но DB-9 используется так же часто, потому что он более простой и дешевый. Стандартным (наиболее распространенным) коннектором для оптических кабелей является SC коннектор, он обеспечивает качественное, четкое соединение. Для обычного подключения используются многомодовые SC коннекторы, а для отдаленного - одномодовые. В многопортовых адаптерах используются микроконнекторы.

Наиболее распространены адаптеры для FC под шину PCI 64 bit. Также много FC адаптеров вырабатывается под шину S-BUS, для специализированного использования выпускаются адаптеры под MCA, EISA, GIO, HIO, PMC, Compact PCI. Самые популярные - однопортовые, встречаются двух- и четырехпортовые карточки. На PCI адаптерах, как правило, используют DB-9, HSSD, SC коннекторы. Также часто встречаются GBIC-based адаптеры, которые поставляются как с модулями GBIC, так и без них. Fibre Channel адаптеры отличаются классами, которые они поддерживают, и разнообразными особенностями. Для понимания отличий приведем сравнительную таблицу адаптеров производства фирмы QLogic.

| Fibre Channel Host Bus Adapter Family Chart | ||||||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| SANblade | 64 Bit | FCAL Publ. Pvt Loop | FL Port | Class 3 | F Port | Class 2 | Point to Point | IP/ SCSI | Full Duplex | FC Tape | PCI 1.0 Hot Plug Spec | Solaris Dynamic Reconfig | VIВ | 2Gb |

| 2100 Series | 33 & 66MHz PCI | X | X | X | ||||||||||

| 2200 Series | 33 & 66MHz PCI | X | X | X | X | X | X | X | X | X | ||||

| 33MHz PCI | X | X | X | X | X | X | X | X | X | X | ||||

| 25 MHZ Sbus | X | X | X | X | X | X | X | X | X | X | ||||

| 2300 Series | 66 MHZ PCI/ 133MHZ PCI-X | X | X | X | X | X | X | X | X | X | X | X | ||

Концентраторы

Fibre Channel HUBs (концентраторы) используются для подключения нод к FC кольцу (FC Loop) и имеют структуру, похожую на Token Ring концентраторы. Поскольку разрыв кольца может привести к прекращению функционирования сети, в современных FC концентраторах используются порты обхода кольца (PBC-port bypass circuit), которые разрешают автоматически открывать/закрывать кольцо (подключать/отключать системы, присоединенные к концентратору). Обычно FC HUBs поддерживают до 10 подключений и могут стекироваться до 127 портов на кольцо. Все устройства, подключенные к HUB, получают общую полосу пропускания, которую они могут разделять между собой.

Коммутаторы

Fibre Channel Switches (коммутаторы) имеют те же функции, что и привычные читателю LAN коммутаторы. Они обеспечивают полноскоростное неблокированное подключение между нодами. Любая нода, подключенная к FC коммутатору, получает полную (с возможностями масштабирования) полосу пропускания. При увеличении количества портов коммутированной сети ее пропускная способность увеличивается. Коммутаторы могут использоваться вместе с концентраторами (которые используют для участков, не требующих выделенной полосы пропуска для каждой ноды) для достижения оптимального соотношения цена/производительность. Благодаря каскадированию свичи потенциально могут использоваться для создания FC сетей с количеством адресов 2 24 (свыше 16 миллионов).

Мосты

FC Bridges (мосты или мультиплексоры) используются для подключения устройств с параллельным SCSI к сети на базе FC. Они обеспечивают трансляцию SCSI пакетов между Fibre Channel и Parallel SCSI устройствами, примерами которых могут служить Solid State Disk (SSD) или библиотеки на магнитных лентах. Следует заметить, что в последнее время практически все устройства, которые могут быть утилизированы в рамках SAN, производители начинают выпускать с вмонтированным FC интерфейсом для прямого их подключения к сетям хранения данных.

Серверы и Сторедж

Несмотря на то что серверы и сторедж - далеко не последние по важности компоненты SAN, мы на их описании останавливаться не будем, поскольку уверены, что с ними хорошо знакомы все наши читатели.

В конце хочется добавить, что эта статья - лишь первый шаг к сетям хранения данных. Для полного понимания темы читателю следует уделить немало внимания особенностям реализации компонент производителями SAN и программным средствам управления, поскольку без них Storage Area Network - это всего лишь набор элементов для коммутации сторедж-систем, которые не принесут вам полноты преимуществ от реализации сети хранения данных.

Заключение

Сегодня Storage Area Network является довольно новой технологией, которая в скором времени может стать массовой в кругу корпоративных заказчиков. В Европе и США предприятия, которые имеют достаточно большой парк инсталлированных сторедж-систем, уже начинают переходить на сети хранения данных для организации сторедж с наилучшим показателем общей стоимости владения.

По прогнозам аналитиков, в 2005 году значительное количество серверов среднего и верхнего уровня будут поставляться с предварительно установленным интерфейсом Fibre Channel (такую тенденцию можно заметить уже сегодня), и лишь для внутреннего подключения дисков в серверах будет использоваться параллельный SCSI интерфейс. Уже сегодня при построении сторедж-систем и приобретении серверов среднего и верхнего уровня следует обратить внимание на эту перспективную технологию, тем более, что уже сегодня она дает возможность реализовать ряд задач куда дешевле, чем с помощью специализированных решений. Кроме того, вкладывая в технологию SAN сегодня, вы не потеряете свои вложения завтра, поскольку особенности Fibre Channel создают прекрасные возможности для использования в будущем вложенных сегодня инвестиций.

P.S.

Предыдущая версия статьи была написана в июне 2000 года, но в связи с отсутствием массового интереса к технологии сетей хранения данных публикация была отложена на будущее. Это будущее настало сегодня, и я надеюсь, что данная статья побудит читателя осознать необходимость перехода на технологию сетей хранения данных, как передовую технологию построения сторедж-систем и организации доступа к данным.

Если Серверы - это универсальные устройства, выполняющие в большинстве случаев

- либо функцию сервера приложения (когда на сервере выполняются специальные программы, и идут интенсивные вычисления),

- либо функцию файл-сервера (т.е. некоего места для централизованного хранения файлов данных)

то СХД (Системы Хранения Данных) - устройства, специально спроектированные для выполнения таких серверных функций, как хранение данных.

Необходимость приобретения СХД

возникает обычно у достаточно зрелых предприятий, т.е. тех, кто задумывается над тем, как

- хранить и управлять информацией, самым ценным активом компании

- обеспечить непрерывность бизнеса и защиту от потери данных

- увеличить адаптируемость ИТ-инфраструктуры

СХД и виртуализация

Конкуренция заставляет компании МСБ работать эффективней, без простоев и с высоким КПД. Смена производственных моделей, тарифных планов, видов услуг происходит всё чаще. Весь бизнез современных компаний "завязан" на информационных технологиях. Потребности бизнеса меняются быстро, и мгновенно отражаются на ИТ - растут требования к надёжности и адаптируемости ИТ-инфраструктуры. Виртуализация предоставляет такие возможности, но для этого нужны недорогие и простые в обслуживании системы хранения данных.

Классификация СХД по типу подключения

DAS . Первые дисковые массивы соединялись с серверами по интерфейсу SCSI. При этом один сервер мог работать только с одним дисковым массивом. Это - прямое соединение СХД (DAS - Direct Attached Storage).

NAS . Для более гибкой организации структуры вычислительного центра - чтобы каждый пользователь мог использовать любую систему хранения - необходимо подключить СХД в локальную сеть. Это - NAS - Network Attached Storage). Но обмен данными между сервером и СХД во много раз более интенсивный чем между клиентом и сервером, поэтому в таком варианте варианте появились объективные трудности, связанные с пропускной способностью сети Ethernet. Да и с точки зрения безопасности не совсем правильно показывать СХД в общую сеть.

SAN . Но можно создать между серверами и СХД свою, отдельную, высокоскоростную сеть. Такую сеть назвали SAN (Storage Area Network). Быстродействие обеспечивается тем, что физической средой передачи там является оптика. Специальные адаптеры (HBA) и оптические FC-коммутаторы обеспечивают передачу данных на скорости 4 и 8Gbit/s. Надёжность такой сети повышалась резервированием (дупликацией) каналов (адаптеров, коммутаторов). Основным недостатком является высокая цена.

iSCSI . С появлением недорогих Ethernet-технологий 1Gbit/s и 10Gbit/s, оптика со скоростью передачи 4Gbit/s уже выглядит не так привлекательно, особенно с учетом цены. Поэтому всё чаще в качестве среды SAN используется протокол iSCSI (Internet Small Computer System Interface). Сеть iSCSI SAN может быть построена на любой достаточно быстрой физической основе, поддерживающей протокол IP.

Классификация Систем Хранения Данныхпо области применения:

| класс | описание |

|

personal |

Чаще всего представляют из себя обычный 3.5" или 2.5" или 1.8" жесткий диск, помещенный в специальный корпус и оснащенный интерфейсами USB и/или FireWire 1394 и/или Ethernet, и/или eSATA. |

small workgroup |

Обычно это стационарное или переносное устройство, в которое можно устанавливать несколько (чаще всего от 2 до 5) жестких дисков SATA, с возможностью горячей замены или без, имеющее интерфейс Ethernet. Диски можно организовывать в массивы - RAID различного уровня для достижения высокой надежности хранения и скорости доступа. СХД имеет специализированную ОС, обычно на основе Linux, и позволяет разграничивать уровень доступа по имени и паролю пользователей, организовывать квотирование дискового пространства и т.п. |

|

workgroup |

Устройство, обычно монтируемое в 19" стойку (rack-mount) в которое можно устанавливать 12-24 жестких дисков SATA или SAS с возможностью горячей замены HotSwap. Имеет внешний интерфейс Ethernet, и/или iSCSI. Диски организованы в массивы - RAID для достижения высокой надежности хранения и скорости доступа. СХД поставляется со специализированным программным обеспечением, которое позволяет разграничивать уровень доступа, организовывать квотирование дискового пространства, организовывать BackUp (резервное копирование информации) и т.п. Такие СХД подходят для средних и крупных предприятий, и используются совместно с одним или несколькими серверами. |

enterprise  |

Стационарное устройство или устройство, монтируемое в 19" стойку (rack-mount) в которое можно устанавливать до сотен жестких дисков. В дополнение к предыдущему классу СХД могут иметь возможность наращивания, модернизации и замены компонент без остановки системы, системы мониторинга. Программное обеспечение может поддерживать создание "моментальных снимков" и другие "продвинутые" функции. Такие СХД подходят для больших предприятий и обеспечивают повышенную надежность, скорость и защиту критически важных данных. |

|

high-end enterprise |

В дополнение к предыдущему классу СХД может поддерживать тысячи жестких дисков. |

История вопроса.

Первые серверы сочетали в одном корпусе все функции (как компьютеры) - и вычислительные (сервер приложений) и хранение данных (файл-сервер). Но по мере роста потребности приложений в вычислительных мощностях с одной стороны и по мере роста количества обрабатываемых данных с другой стороны - стало просто неудобно размещать все в одном корпусе. Эффективнее оказалось выносить дисковые массивы в отдельные корпуса. Но тут встал вопрос соединения дискового массива с сервером. Первые дисковые массивы соединялись с серверами по интерфейсу SCSI. Но в таком случае один сервер мог работать только с одним дисковым массивом. Народу захотелось более гибкой организации структуры вычислительного центра - чтобы любой сервер мог использовать любую систему хранения. Подключить все устройства напрямую в локальную сеть и организовать обмен данными по Ethernet - конечно, простое и универсальное решение. Но обмен данными между серверами и СХД во много раз более интенсивный чем между клиентами и серверами, поэтому в таком варианте варианте (NAS - см. ниже) появились объективные трудности, связанные с пропускной способностью сети Ethernet. Возникла идея создать между серверами и СХД свою, отдельную высокоскоростную сеть. Такую сеть назвали SAN (см. ниже). Она похожа на Ethernet, только физической средой передачи там является оптика. Там тоже есть адаптеры (HBA), которые устанавливаются в серверы и коммутаторы (оптические). Стандарты на скорость передачи данных по оптике - 4Gbit/s. С появлением технологий Ethernet 1Gbit/s и 10Gbit/s, а также протокола iSCSI всё чаще в качестве среды SAN используется Ethernet.

Зависимость бизнес-процессов предприятия от ИТ-сферы постоянно растет. На сегодня вопросу непрерывности работы ИТ-сервисов уделяют внимание не только крупные компании, но и представители среднего, а зачастую и малого бизнеса.

Одним из центральных элементов обеспечения отказоустойчивости является система хранения данных (СХД) - устройство на котором централизовано храниться вся информация. СХД характеризуется высокой масштабируемостью, отказоустойчивостью, возможностью выполнять все сервисные операции без остановки работы устройства (в том числе замену компонентов). Но стоимость даже базовой модели измеряется в десятках тысяч долларов. Например, Fujitsu ETERNUS DX100 с 12-ю дисками Nearline SAS 1Tb SFF (RAID10 6TB) стоит порядка 21 000 USD , что для небольшой компании очень дорого.

В нашей статье мы предлагаем рассмотреть варианты организации бюджетного хранилища , которое не проигрывает по производительности и надежности классическим системам. Для его реализации предлагаем использовать CEPH .

Что такое CEPH и как он работает?

CEPH – хранилище на базе свободного ПО, представляет из себя объединение дисковых пространств нескольких серверов (количество серверов на практике измеряется десятками и сотнями). CEPH позволяет создать легкомасштабируемое хранилище с высокой производительностью и избыточностью ресурсов. CEPH может использоваться как в качестве объектного хранилища (служить для хранения файлов) так и в качестве блочного устройства (отдача виртуальных жестких дисков).

Отказоустойчивость хранилища обеспечивается репликацией каждого блока данных на несколько серверов. Количество одновременно хранимых копий каждого блока называется фактором репликации, по умолчанию его значение равно 2. Схема работы хранилища показана на рисунке 1, как видим информация разбивается на блоки, каждый из которых распределяется по двум разным нодам.

Рисунок 1 - Распределение блоков данных

Если на серверах не используются отказоустойчивые дисковые массивы, для надежного хранения данных рекомендуется использовать более высокое значение фактора репликации. В случае выхода из строя одного из серверов CEPH фиксирует недоступность блоков данных (рисунок 2), которые на нем размещены, ожидает определенное время (параметр настраивается, по умолчанию 300 сек.), после чего начинает воссоздание недостающих блоков информации в другом месте (рисунок 3).

Рисунок 2 - Выход из строя одной ноды

Рисунок 3 - Восстановление избыточности

Аналогично, в случае добавления в кластер нового сервера происходит ребаллансировка хранилища с целью равномерного заполнения дисков на всех нодах. Механизм который контролирует процессы распределения блоков информации в кластере CEPH называется CRUSH.

Для получения высокой производительности дискового пространства в кластерах CEPH рекомендуется использовать функционал cache tiering (многоуровневое кэширование). Смысл его заключается в том, чтобы создать отдельный высокопроизводительный пул и использовать его для кэширования, основная же информация будет размещена на более дешевых дисках (рисунок 4).

Рисунок 4 - Логическое представление дисковых пулов

Многоуровневое кэширование будет работать следующим образом: запросы клиентов на запись будут записываться в самый быстрый пул, после чего перемещаться на уровень хранения. Аналогично по запросам на чтение – информация при обращении будет подниматься на уровень кэширования и обрабатываться. Данные продолжают оставаться на уровне кэша пока не становятся неактивными или пока не теряют актуальность (рисунок 5). Стоит отметить, что кэширование можно настроить только на чтение, в этом случае запросы на запись будут заноситься прямо в пул хранения.

Рисунок 5 - Принцип работы кэш-тирринг

Рассмотрим реальные сценарии использования CEPH в организации для создания хранилища данных. В качестве потенциального клиента рассматриваются организации малого и среднего бизнеса, где будет наиболее востребована эта технология. Мы рассчитали 3 сценария использования описанного решения:

- Производственное или торговое предприятие с требованием к доступности внутренней ERP системы и файлового хранилища 99,98% в год, 24/7.

- Организация, которой для ее бизнес-задач требуется развернуть локальное частное облако.

- Очень бюджетное решение для организации отказоустойчивого блочного хранилища данных, полностью независимое от аппаратного обеспечения с доступностью 99,98% в год и недорогим масштабированием.

Сценарий использования 1. Хранилище данных на базе CEPH

Рассмотрим реальный пример применения CEPH в организации. Например, нам требуется отказоустойчивое производительное хранилище объемом 6 Тб, но затраты даже на базовую модель СХД с дисками составляют порядка $21 000 .

Собираем хранилище на базе CEPH. В качестве серверов предлагаем использовать решение Supermicro Twin (Рисунок 6). Продукт представляет собой 4 серверные платформы в едином корпусе высотой 2 юнита, все основные узлы устройства дублируются, что обеспечивает его непрерывное функционирование. Для реализации нашей задачи будет достаточно использовать 3 ноды, 4-я будет в запасе на будущее.

Рисунок 6 - Supermicro Twin

Комплектуем каждую из нод следующим образом: 32 Гб ОЗУ, 4-х ядерный процессор 2,5 Ггц, 4 SATA диска по 2 Тб для пула хранения объединяем в 2 массива RAID1, 2 SSD диска для пула кэширования также объединяем в RAID1 . Стоимость всего проекта указана в таблице 1.

Таблица 1. Комплектующие для хранилища на базе CEPH

| Комплектующие | Цена, USD | Кол-во | Стоимость, USD |

| 4 999,28 | 1 | 4 999,28 | |

| 139,28 | 6 | 835,68 | |

| Процессор Ivy Bridge-EP 4-Core 2.5GHz (LGA2011, 10MB, 80W, 22nm) Tray | 366,00 | 3 | 1 098,00 |

| 416,00 | 12 | 4 992,00 | |

| 641,00 | 6 | 3 846,00 | |

| ИТОГО | 15 770,96 | ||

Вывод: В результате построения хранилища получим дисковый массив 6Tb c затратами порядка $16 000 , что на 25% меньше чем закупка минимальной СХД, при этом на текущих мощностях можно запустить виртуальные машины, работающие с хранилищем, тем самым сэкономить на покупке дополнительных серверов. По сути – это законченное решение.

Серверы, из которых строится хранилище, можно использовать не только как вместилище жестких дисков, но в качестве носителей виртуальных машин или серверов приложений.

Сценарий использования 2. Построение частного облака

Задача состоит в том, чтобы развернуть инфраструктуру для построения частного облака с минимальными затратами.

Построение даже небольшого облака состоящего из например из 3-х носителей примерно в $36 000 : $21 000 – стоимость СХД + $5000 за каждый сервер с 50% наполнением.

Использование CEPH в качестве хранилища позволяет совместить вычислительные и дисковые ресурсы на одном оборудовании. То есть не нужно закупать отдельно СХД - для размещения виртуальных машин будут использоваться диски установленные непосредственно в серверы.

Краткая справка:

Классическая облачная структура представляет из себя кластер виртуальных машин, функционирование которых обеспечивают 2 основных аппаратных компонента:

- Вычислительная часть (compute) - серверы, заполненные оперативной памятью и процессорами, ресурсы которых используются виртуальными машинами для вычислений

- Система хранения данных (storage) – устройство наполненное жесткими дисками, на котором хранятся все данные.

В качестве оборудования берем те же серверы Supermicro, но ставим более мощные процессоры – 8-ми ядерные с частотой 2,6 GHz, а также 96 Гб ОЗУ в каждую ноду , так как система будет использоваться не только для хранения информации, но и для работы виртуальных машин. Набор дисков берем аналогичный первому сценарию.

Таблица 2. Комплектующие для частного облака на базе CEPH

| Комплектующие | Цена, USD | Кол-во | Стоимость, USD |

| Supermicro Twin 2027PR-HTR: 4 hot-pluggable systems (nodes) in a 2U form factor. Dual socket R (LGA 2011), Up to 512GB ECC RDIMM, Integrated IPMI 2.0 with KVM and Dedicated LAN. 6x 2.5" Hot-swap SATA HDD Bays. 2000W Redundant Power Supplies | 4 999,28 | 1 | 4 999,28 |

| Модуль памяти Samsung DDR3 16GB Registered ECC 1866Mhz 1.5V, Dual rank | 139,28 | 18 | 2 507,04 |

| Процессор Intel Xeon E5-2650V2 Ivy Bridge-EP 8-Core 2.6GHz (LGA2011, 20MB, 95W, 32nm) Tray | 1 416,18 | 3 | 4 248,54 |

| Жесткий диск SATA 2TB 2.5" Enterprise Capacity SATA 6Gb/s 7200rpm 128Mb 512E | 416 | 12 | 4 992,00 |

| Твердотельный накопитель SSD 2.5"" 400GB DC S3710 Series. | 641 | 6 | 3 846,00 |

| ИТОГО | 20 592,86 | ||

Собранное облако будет иметь следующие ресурсы с учетом сохранения стабильности при выходе из строя 1-й ноды:

- Оперативная память: 120 Гб

- Дисковое пространство 6000 Гб

- Процессорные ядра физические: 16 Шт.

Собранный кластер сможет поддерживать порядка 10 средних виртуальных машин с характеристиками: 12 ГБ ОЗУ / 4 процессорных ядра / 400 ГБ дискового пространства.

Также стоит учесть что все 3 сервера заполнены только на 50% и при необходимости их можно доукомплектовать, тем самым увеличив пул ресурсов для облака в 2 раза.

Вывод: Как видим, мы получили как полноценный отказоустойчивый кластер виртуальных машин, так и избыточное хранилище данных - выход из строя любого из серверов не критичен – система продолжит функционирование без остановки, при этом стоимость решения примерно в 1,5 раза ниже , чем купить СХД и отдельные сервера.

Сценарий использования 3. Построение сверхдешевого хранилища данных

Если бюджет совсем ограничен и нет денег на закупку оборудования описанного выше, можно закупить серверы бывшие в употреблении, но на дисках экономить не стоит – их настоятельно рекомендуется купить новые.

Предлагаем рассмотреть следующую структуру: закупается 4 серверные ноды, в каждый сервер ставиться по 1 SSD-диску для кэширования и по 3 SATA диска . Серверы Supermicro с 48 ГБ ОЗУ и процессорами линейки 5600 можно сейчас купить примерно за $800 .

Диски не будут собираться в отказоустойчивые массивы на каждом сервере, а будут представлены как отдельное устройство. В связи с этим для повышения надежности хранилища будем использовать фактор репликации 3. То есть у каждого блока будет 3 копии. При такой архитектуре зеркалирования дисков SSD кеша не требуется, так как происходит автоматическое дублирование информации на другие ноды.

Таблица 3. Комплектующие для стореджа

Вывод: В случае необходимости в данном решении можно использовать диски большего объема, либо заменить их на SAS, если нужно получить максимальную производительность для работы СУБД. В данном примере в результате получим хранилище объемом 8 ТБ с очень низкой стоимостью и очень высокой отказоустойчивостью. Цена одного терабайта получилась в 3,8 раза дешевле , чем при использовании промышленной СХД за $21000.

Итоговая таблица, выводы

| Конфигурация | СХД Fujitsu ETERNUS DX100 + 12 Nearline SAS 1Tb SFF (RAID10) | СХД Fujitsu ETERNUS DX100 + 12 Nearline SAS 1Tb SFF (RAID10) + Supermicro Twin | Наш сценарий 1: хранилище на базе CEPH | Наш сценарий 2: построение частного облака | Нашсценарий 3: построение сверхдешевого хранилища |

| Полезный обьем, ГБ | 6 000 | 6 000 | 6 000 | 6000 | 8 000 |

| Цена, USD | 21000 | 36000 | 15 770 | 20 592 | 7 324 |

| Стоимость 1 ГБ, USD | 3,5 | 6 | 2,63 | 3,43 | 0,92 |

| Количество IOPs* (чтение 70%/запись 30%, Размер блока 4К) | 760 | 760 | 700 | 700 | 675 |

| Назначение | Хранилище | Хранилище + Вычисление | Хранилище + Вычисление | Хранилище + Вычисление | Хранилище + Вычисление |

*Расчет количества IOPs выполнен для созданных массивов из дисков NL SAS на СХД и дисков SATA на сторедже CEPH, кэширование отключалось для чистоты полученных значений. При использовании кэширования показатели IOPs будут значительно выше до момента заполнения кэша.

В итоге можно сказать, что на основе кластера CEPH можно строить надежные и дешевые хранилища данных. Как показали расчеты, использовать ноды кластера только для хранения не очень эффективно – решение выходит дешевле чем закупить СХД, но не на много – в нашем примере стоимость хранилища на CEPH была примерно на 25% меньше чем Fujitsu DX100. По-настоящему экономия ощущается в результате совмещения вычислительной части и хранилища на одном оборудовании - в таком случае стоимость решения будет в 1,8 раз меньше, чем при построении классической структуры с применением выделенного хранилища и отдельных хост-машин.

Компания EFSOL реализует данное решение по индивидуальным требованиям. Мы можем использовать имеющееся у вас оборудование, что ещё более снизит капитальные затраты на внедрение системы. Свяжитесь с нами и мы проведем обследование вашего оборудования на предмет его использования при создании СХД.

Системы хранения данных с прямым подключением (DAS) реализуют самый известный тип соединения. При использовании DAS сервер имеет персональную связь с СХД и почти всегда является единоличным пользователем устройства. При этом сервер получает блочный доступ к системе хранения данных, то есть обращается непосредственно к блокам данных.

Системы хранения данных такого типа достаточно простые и обычно недорогие. Недостатком прямого способа подключения является небольшое расстояние между сервером и устройством хранения. Типичным интерфейсом DAS является SAS.

Network Attached Storage (NAS)

Сетевые системы хранения данных (NAS), также известные как файловые серверы, предоставляют свои сетевые ресурсы клиентам по сети в виде совместно используемых файлов или точек монтирования каталогов. Клиенты используют протоколы сетевого доступа к файлам, такие как SMB (ранее известный как CIFS) или NFS. Файловый сервер, в свою очередь, использует протоколы блочного доступа к своему внутреннему хранилищу для обработки запросов файлов клиентами. Так как NAS работает по сети, хранилище может быть очень далеко от клиентов. Множество сетевых систем хранения данных предоставляет дополнительные функции, такие как снятие образов хранилища, дедупликация или компрессия данных и другие.

Storage Area Network (SAN)

Сеть хранения данных (SAN) предоставляет клиентам блочный доступ к данным по сети (например, Fibre Channel или Ethernet). Устройства в SAN не принадлежат одному серверу, а могут использоваться всеми клиентами сети хранения. Возможно разделение дискового пространства на логические тома, которые выделяются отдельным хост-серверам. Эти тома не зависят от компонентов SAN и их размещения. Клиенты обращаются к хранилищу данных с использованием блочного типа доступа, как и при DAS подключении, но, так как SAN использует сеть, устройства хранения данных могут располагаться далеко от клиентов.

В настоящее время SAN архитектура используют протокол SCSI (Small Computer System Interface) для передачи и получения данных. Fibre Channel (FC) SAN инкапсулируют протокол SCSI в Fibre Channel фреймы. Сети хранения данных, использующие iSCSI (Internet SCSI) используют в качестве транспорта SCSI TCP/IP пакеты. Fibre Channel over Ethernet (FCoE) инкапсулирует протокол Fibre Channel в пакеты Ethernet, используя относительно новую технологию DCB (Data Center Bridging), которая вносит набор улучшений в традиционный Ethernet и может в настоящее время быть развернута на 10GbE инфраструктуре. Благодаря тому, что каждая из этих технологий позволяет приложениям получать доступ к хранилищу данных используя один и тот же протокол SCSI, становится возможным использовать их все в одной компании или мигрировать с одной технологии на другую. Приложения, запущенные на сервере, не могут различить FC, FCoE, iSCSI и даже отличить DAS от SAN.

Ведется множество обсуждений по поводу выбора FC или iSCSI для построения сети хранения данных. Некоторые компании фокусируются на невысокой стоимости первоначального развертывания iSCSI SAN, другие выбирают высокую надежность и доступность Fibre Channel SAN. Хотя low-end решения iSCSI дешевле, чем Fibre Channel, с ростом производительности и надежности iSCSI SAN ценовое преимущество исчезает. При этом появляются некоторые реализации FC, которые проще в использовании, чем большинство iSCSI решений. Поэтому выбор той или иной технологии зависит от бизнес-требований, существующей инфраструктуры, экспертизы и бюджета.

Большинство крупных организаций, которые используют сети хранения данных, выбирают Fibre Channel. Эти компании обычно требуют проверенную технологию, имеют необходимость в высокой пропускной способности и обладают бюджетом для покупки самого надежного и производительного оборудования. Кроме того, они располагают персоналом для управления сетью хранения данных. Некоторые из таких компаний планируют продолжать инвестиции в Fibre Channel инфраструктуру, другие же инвестируют в решения iSCSI, особенно 10GbE, для своих виртуализированных серверов.

Небольшие компании чаще выбирают iSCSI из-за низкого ценового порога входа, при этом они получают возможность для дальнейшего масштабирования SAN. Недорогие решения обычно используют технологию 1GbE; решения от 10GbE стоят существенно дороже и как правило не рассматриваются в качестве SAN начального уровня.

Unified Storage

Универсальные системы хранения данных (Unified Storage) совмещают в себе технологии NAS и SAN в едином интегрированном решении. Эти универсальные хранилища позволяют использовать как блочный, так и файловый тип доступа к общим ресурсам, кроме того, управление такими устройствами проще благодаря ПО, обеспечивающему централизованное управление.

В простейшем случае SAN состоит из СХД , коммутаторов и серверов, объединённых оптическими каналами связи. Помимо непосредственно дисковых СХД в SAN можно подключить дисковые библиотеки, ленточные библиотеки (стримеры), устройства для хранения данных на оптических дисках (CD/DVD и прочие) и др.

Пример высоконадёжной инфраструктуры, в которой серверы включены одновременно в локальную сеть (слева) и в сеть хранения данных (справа). Такая схема обеспечивает доступ к данным, находящимся на СХД, при выходе из строя любого процессорного модуля, коммутатора или пути доступа.

Использование SAN позволяет обеспечить:

- централизованное управление ресурсами серверов и систем хранения данных ;

- подключение новых дисковых массивов и серверов без остановки работы всей системы хранения;

- использование ранее приобретенного оборудования совместно с новыми устройствами хранения данных;

- оперативный и надежный доступ к накопителям данных, находящимся на большом расстоянии от серверов, *без значительных потерь производительности;

- ускорение процесса резервного копирования и восстановления данных - BURA .

История

Развитие сетевых технологий привело к появлению двух сетевых решений для СХД – сетей хранения Storage Area Network (SAN) для обмена данными на уровне блоков, поддерживаемых клиентскими файловыми системами, и серверов для хранения данных на файловом уровне Network Attached Storage (NAS). Чтобы отличать традиционные СХД от сетевых был предложен еще один ретроним – Direct Attached Storage (DAS).

Появлявшиеся на рынке последовательно DAS, SAN и NAS отражают эволюционирующие цепочки связей между приложениями, использующими данные, и байтами на носителе, содержащим эти данные. Когда-то сами программы-приложения читали и писали блоки, затем появились драйверы как часть операционной системы. В современных DAS, SAN и NAS цепочка состоит из трех звеньев: первое звено – создание RAID-массивов, второе – обработка метаданных, позволяющих интерпретировать двоичные данные в виде файлов и записей, и третье – сервисы по предоставлению данных приложению. Они различаются по тому, где и как реализованы эти звенья. В случае с DAS СХД является «голой», она только лишь предоставляет возможность хранения и доступа к данным, а все остальное делается на стороне сервера, начиная с интерфейсов и драйвера. С появлением SAN обеспечение RAID переносится на сторону СХД, все остальное остается так же, как в случае с DAS. А NAS отличается тем, что в СХД переносятся к тому же и метаданные для обеспечения файлового доступа, здесь клиенту остается только лишь поддерживать сервисы данных.

Появление SAN стало возможным после того, как в 1988 году был разработан протокол Fibre Channel (FC) и в 1994 утвержден ANSI как стандарт. Термин Storage Area Network датируется 1999 годом. Со временем FC уступил место Ethernet, и получили распространение сети IP-SAN с подключением по iSCSI.

Идея сетевого сервера хранения NAS принадлежит Брайану Рэнделлу из Университета Ньюкэстла и реализована в машинах на UNIX-сервере в 1983 году. Эта идея оказалась настолько удачной, что была подхвачена множеством компаний, в том числе Novell, IBM , и Sun, но в конечном итоге сменили лидеров NetApp и EMC.

В 1995 Гарт Гибсон развил принципы NAS и создал объектные СХД (Object Storage, OBS). Он начал с того, что разделил все дисковые операции на две группы, в одну вошли выполняемые более часто, такие как чтение и запись, в другую более редкие, такие как операции с именами. Затем он предложил в дополнение к блокам и файлам еще один контейнер, он назвал его объектом.

OBS отличается новым типом интерфейса, его называют объектным. Клиентские сервисы данных взаимодействуют с метаданными по объектному API (Object API). В OBS хранятся не только данные, но еще и поддерживается RAID, хранятся метаданные, относящиеся к объектам и поддерживается объектный интерфейс. DAS, и SAN, и NAS, и OBS сосуществуют во времени, но каждый из типов доступа в большей мере соответствует определенному типу данных и приложений.

Архитектура SAN

Топология сети

SAN является высокоскоростной сетью передачи данных, предназначенной для подключения серверов к устройствам хранения данных. Разнообразные топологии SAN (точка-точка, петля с арбитражной логикой (Arbitrated Loop) и коммутация) замещают традиционные шинные соединения «сервер - устройства хранения» и предоставляют по сравнению с ними большую гибкость, производительность и надежность. В основе концепции SAN лежит возможность соединения любого из серверов с любым устройством хранения данных, работающим по протоколу Fibre Channel . Принцип взаимодействия узлов в SAN c топологиями точка-точка или коммутацией показан на рисунках. В SAN с топологией Arbitrated Loop передача данных осуществляется последовательно от узла к узлу. Для того, чтобы начать передачу данных передающее устройство инициализирует арбитраж за право использования среды передачи данных (отсюда и название топологии – Arbitrated Loop).

Транспортную основу SAN составляет протокол Fibre Channel, использующий как медные, так и волоконно-оптические соединения устройств.

Компоненты SAN

Компоненты SAN подразделяются на следующие:

- Ресурсы хранения данных;

- Устройства, реализующие инфраструктуру SAN;

Host Bus Adaptors

Ресурсы хранения данных

К ресурсам хранения данных относятся дисковые массивы , ленточные накопители и библиотеки с интерфейсом Fibre Channel . Многие свои возможности ресурсы хранения реализуют только будучи включенными в SAN. Так дисковые массивы высшего класса могут осуществлять репликацию данных между масcивами по сетям Fibre Channel, а ленточные библиотеки могут реализовывать перенос данных на ленту прямо с дисковых массивов с интерфейсом Fibre Channel, минуя сеть и серверы (Serverless backup). Наибольшую популярность на рынке приобрели дисковые массивы компаний EMC , Hitachi , IBM , Compaq (семейство Storage Works , доставшееся Compaq от Digital), а из производителей ленточных библиотек следует упомянуть StorageTek , Quantum/ATL , IBM .

Устройства, реализующие инфраструктуру SAN

Устройствами, реализующими инфраструктуру SAN, являются коммутаторы Fibre Channel (Fibre Channel switches , FC switches),концентраторы (Fibre Channel Hub) и маршрутизаторы (Fibre Channel-SCSI routers).Концентраторы используются для объединения устройств, работающих в режиме Fibre Channel Arbitrated Loop (FC_AL). Применение концентраторов позволяет подключать и отключать устройства в петле без остановки системы, поскольку концентратор автоматически замыкает петлю в случае отключения устройства и автоматически размыкает петлю, если к нему было подключено новое устройство. Каждое изменение петли сопровождается сложным процессом её инициализации . Процесс инициализации многоступенчатый, и до его окончания обмен данными в петле невозможен.

Все современные SAN построены на коммутаторах, позволяющих реализовать полноценное сетевое соединение. Коммутаторы могут не только соединять устройства Fibre Channel , но и разграничивать доступ между устройствами, для чего на коммутаторах создаются так называемые зоны. Устройства, помещенные в разные зоны, не могут обмениваться информацией друг с другом. Количество портов в SAN можно увеличивать, соединяя коммутаторы друг с другом. Группа связанных коммутаторов носит название Fibre Channel Fabric или просто Fabric. Связи между коммутаторами называют Interswitch Links или сокращенно ISL.

Программное обеспечение

Программное обеспечение позволяет реализовать резервирование путей доступа серверов к дисковым массивам и динамическое распределение нагрузки между путями. Для большинства дисковых массивов существует простой способ определить, что порты, доступные через разные контроллеры , относятся к одному диску. Специализированное программное обеспечение поддерживает таблицу путей доступа к устройствам и обеспечивает отключение путей в случае аварии, динамическое подключение новых путей и распределение нагрузки между ними. Как правило, изготовители дисковых массивов предлагают специализированное программное обеспечение такого типа для своих массивов. Компания VERITAS Software производит программное обеспечение VERITAS Volume Manager , предназначенное для организации логических дисковых томов из физических дисков и обеспечивающее резервирование путей доступа к дискам, а также распределение нагрузки между ними для большинства известных дисковых массивов.

Используемые протоколы

В сетях хранения данных используются низкоуровневые протоколы:

- Fibre Channel Protocol (FCP), транспорт SCSI через Fibre Channel. Наиболее часто используемый на данный момент протокол . Существует в вариантах 1 Gbit/s, 2 Gbit/s, 4 Gbit/s, 8 Gbit/s и 10 Gbit/s.

- iSCSI , транспорт SCSI через TCP/IP .

- FCoE , транспортировка FCP/SCSI поверх "чистого" Ethernet.

- FCIP и iFCP , инкапсуляция и передача FCP/SCSI в пакетах IP.

- HyperSCSI , транспорт SCSI через Ethernet .

- FICON транспорт через Fibre Channel (используется только мейнфреймами).

- ATA over Ethernet , транспорт ATA через Ethernet.

- SCSI и/или TCP/IP транспорт через InfiniBand (IB).

Преимущества

- Высокая надёжность доступа к данным, находящимся на внешних системах хранения. Независимость топологии SAN от используемых СХД и серверов.

- Централизованное хранение данных (надёжность, безопасность).

- Удобное централизованное управление коммутацией и данными.

- Перенос интенсивного трафика ввода-вывода в отдельную сеть – разгрузка LAN.

- Высокое быстродействие и низкая латентность.

- Масштабируемость и гибкость логической структуры SAN

- Географические размеры SAN, в отличие от классических DAS, практически не ограничены.

- Возможность оперативно распределять ресурсы между серверами.

- Возможность строить отказоустойчивые кластерные решения без дополнительных затрат на базе имеющейся SAN.

- Простая схема резервного копирования – все данные находятся в одном месте.

- Наличие дополнительных возможностей и сервисов (снапшоты, удаленная репликация).

- Высокая степень безопасности SAN.

Совместное использование систем хранения как правило упрощает администрирование и добавляет изрядную гибкость, поскольку кабели и дисковые массивы не нужно физически транспортировать и перекоммутировать от одного сервера к другому.

Другим приемуществом является возможность загружать сервера прямо из сети хранения. При такой конфигурации можно быстро и легко заменить сбойный